Kafka+Zookeeper集群部署测试

Kafka+Zookeeper集群部署测试

Zookeeper部署

本文使用的是zk3.4.9版本

Kafka部署

下载安装

https://kafka.apache.org/downloads

本文使用的是2.0.0版本, 下方可以直接下载

https://archive.apache.org/dist/kafka/2.0.0/kafka_2.11-2.0.0.tgz

下载解压

1 | curl -OL https://archive.apache.org/dist/kafka/2.0.0/kafka_2.11-2.0.0.tgz |

然后改名

1 | mv kafka_2.11-2.0.0/ kafka |

修改配置

配置文件都在config文件夹下面

主要关注:server.properties 这个文件即可,我们可以发现在目录下有很多文件, 有的可以先不管

1 | # 当前机器在集群中的唯一标识,和zookeeper的myid性质一样 |

consumer.properties

1 | =node1:2181,node2:2181,node3:2181 |

producer.properties

1 | =node1:9092,node2:9092,node3:9092 |

分发文件

安装修改完后把文件夹传到其他机器上

1 | scp -r xxx root@node2:xxxx/ |

分发完后记得将server.properties文件中的broker.id和host.name记得改, 每个节点都不相同

修改环境变量

1 | vim /etc/bashrc |

1 | # 加上 |

1 | # 刷新生效 |

启动Kafka测试

首先启动zk集群

所有zookeeper节点都需要执行

1 | zkServer.sh start |

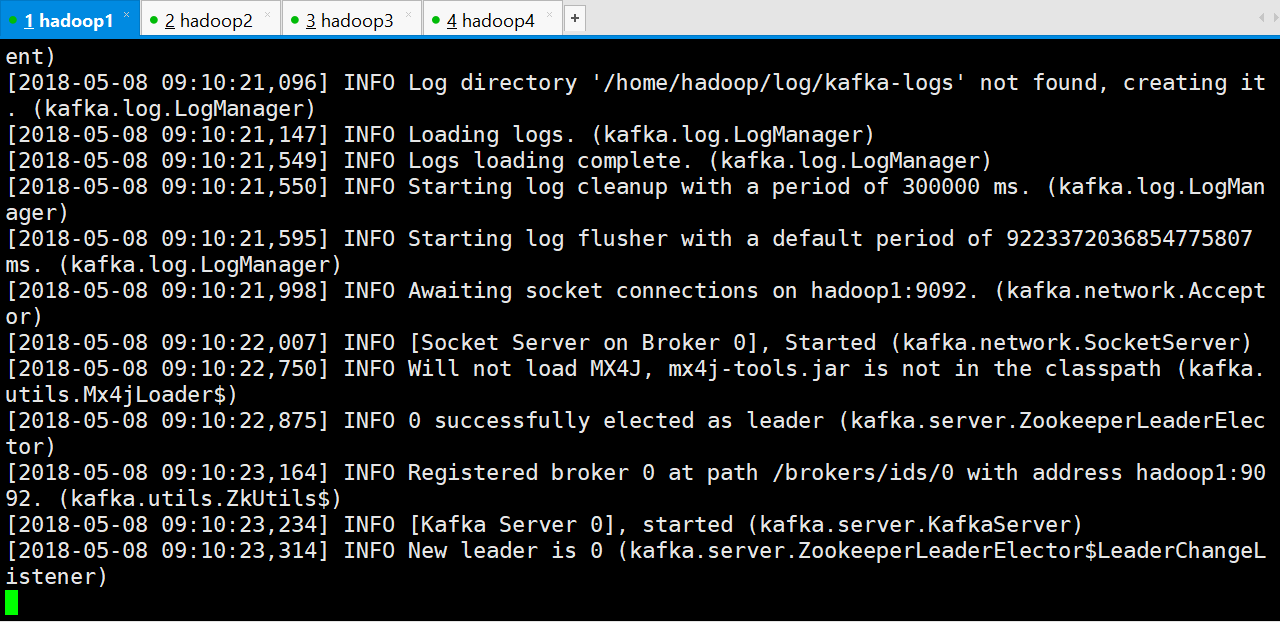

启动Kafka集群服务

每台机器都要启动

1 | bin/kafka-server-start.sh config/server.properties |

启动完成后类似上图 (图是盗的)

topic测试

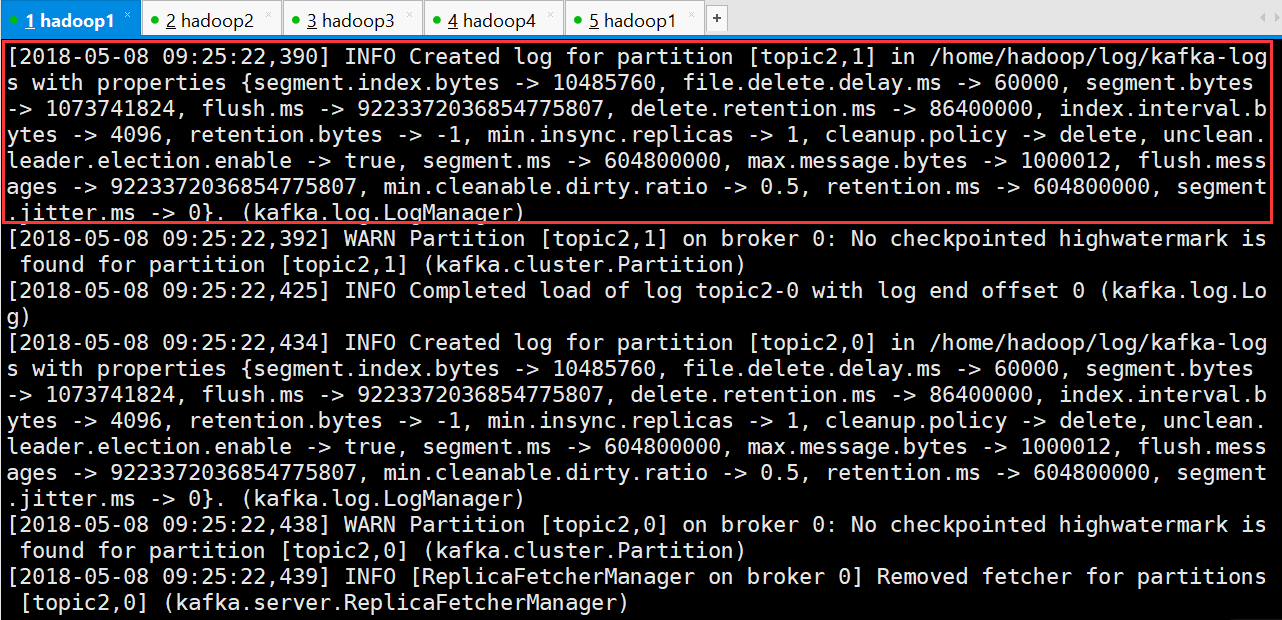

创建topic

1 | bin/kafka-topics.sh --create --zookeeper hadoop1:2181 --replication-factor 3 --partitions 3 --topic topic2 |

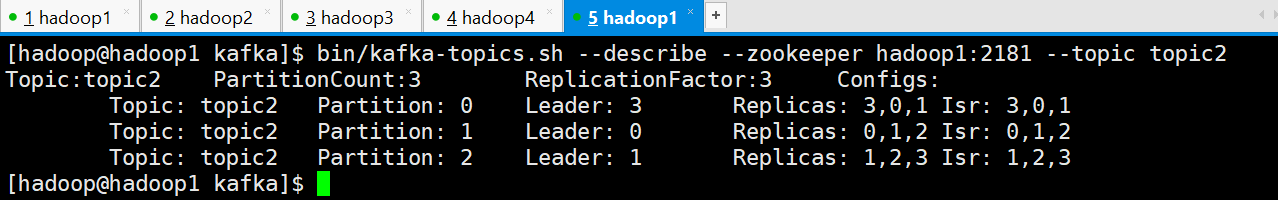

查看topic

查看topic副本信息

1 | bin/kafka-topics.sh --describe --zookeeper node1:2181 --topic topic2 |

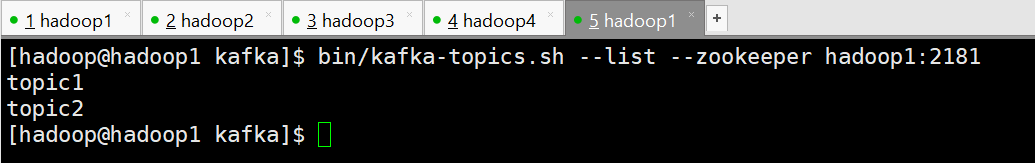

查看已经创建的topic信息

1 | bin/kafka-topics.sh --list --zookeeper node1:2181 |

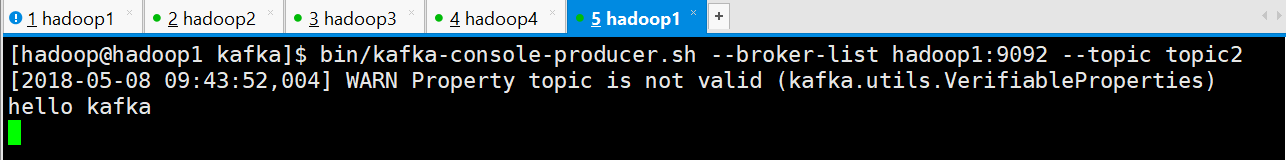

生产者

1 | bin/kafka-console-producer.sh --broker-list node1:9092 --topic topic2 |

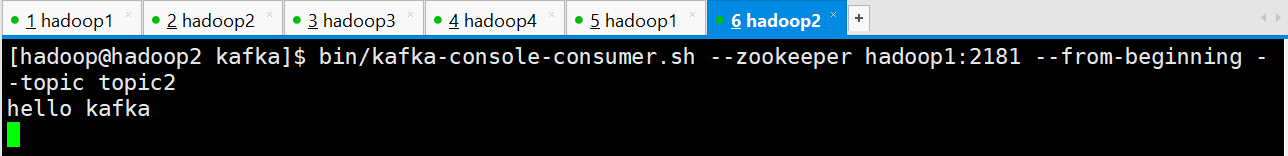

消费者

在另一个机器上

1 | ./bin/kafka-console-consumer.sh --bootstrap-server node1:9092 --from-beginning --topic topic2 |

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来自 Pandolar's Blog!

评论